怎麼分享 AI 研究給團隊,又不丟掉來源和判斷脈絡?

一套分享 AI 研究的實用流程:把研究問題、短答案、來源連結、假設、決策和下一步放在同一份團隊可審查的素材裡。

2026年5月6日

分享 AI 研究時,最危險的不是「摘要寫得不夠漂亮」,而是答案離開原始對話後,來源、假設和判斷脈絡一起消失。

Highlight Reel

保存 AI 研究裡真正有用的片段

把有來源、有判斷脈絡的 AI 研究對話整理成乾淨分享頁或 Markdown,讓團隊可以審查和重用。

比較安全的做法是把短答案和證據放在同一份素材裡:研究問題、來源連結、來源品質、假設、不確定性、決策和下一步都要跟著走。否則團隊看到的只是 AI 摘要,卻沒辦法判斷它能不能被採用。

先講結論

要把 AI 研究分享給團隊,請交出一份短研究 brief,至少包含五塊:

- 研究問題。

- 一段短答案。

- 使用過的來源和連結。

- 假設、不確定性或衝突資訊。

- 因為這份研究要做的決策或下一步。

如果研究是在很長的 ChatGPT、Claude、Gemini、NotebookLM 或其他 AI 對話裡完成,不要把原始對話當成主要交付物。請選出有用片段,保留來源連結和表格,整理成團隊可以審查的乾淨頁面或 Markdown。

為什麼 AI 研究常常丟掉來源?

AI 研究一開始通常很有脈絡:你可能上傳 PDF、貼網頁、要求模型比較來源、讓它做表格、讓它列出引用。

但等到結果被貼到 LINE、Slack、Notion 或 email 時,常常只剩一段漂亮摘要。

這會造成幾個問題:

- 審查的人不知道來源是否真的支持結論。

- 團隊分不清哪些是事實、哪些是假設、哪些是 AI 綜合推論。

- 決策和支持它的 evidence 被拆開。

- 下一個人為了信任結果,只好重新研究一次。

- 原本可點擊的來源變成截圖、模糊描述或「我記得 AI 有查」。

OpenAI 對 ChatGPT Deep Research 的說明提到,研究結果會包含 citations 或 source links,讓使用者可以驗證資訊。這個原則不只適用於 Deep Research。任何會影響團隊決策的 AI 研究,都應該讓答案和證據一起被保存。

來源不丟失的分享流程

1. 先寫清楚研究問題

研究問題要能離開原始 chat 仍然看得懂。

不好:

幫我查一下這個。比較好:

研究問題:如果要把 AI 研究結果交接給產品團隊,應該用 Slack 摘要、共享文件、issue,還是乾淨逐字稿連結?問題越清楚,團隊越容易判斷答案是否完整。

2. 來源要保留成連結,不要變成截圖

模型引用來源時,請把連結保留下來。如果來源來自上傳檔案、內部文件或 NotebookLM notebook,就清楚寫出文件名稱和位置。

不要只放「參考資料很多」這種描述,也不要把來源藏在最後一段。重要 claim 最好能看出它依賴哪個來源。

3. 把 findings、assumptions、inferences 分開

AI 摘要很容易把事實、判斷和猜測寫得同樣順。

分享時請用標籤拆開:

- Finding:有明確來源支持。

- Assumption:合理但未被直接證明。

- Inference:團隊根據多個來源做出的判斷。

- Open question:還需要研究或 owner 審查。

- Decision:團隊因為這份研究要採取的行動。

這不是形式主義。它讓 review 變得可能,而不是要同事在一段漂亮文字裡猜哪些能信。

4. 決策要靠近 evidence

如果研究影響決策,請把決策和支持它的 evidence 放在一起。

| 決策狀態 | 要保留的證據 | Review 負責人 |

|---|---|---|

| 繼續推進 | 直接支持機會、需求或限制的來源。 | 決策 owner |

| 暫停 | 不確定、缺權限、資料不足或來源互相衝突的證據。 | 研究 owner |

| 做小測試 | 假設、成功標準、可觀察指標。 | 實作者 |

| 升級審查 | 法務、資安、客戶影響或合規風險來源。 | 專門 reviewer |

研究不是寫完摘要就完成。它完成於團隊知道下一步要做什麼,以及為什麼可以這樣做。

5. 分享乾淨研究素材

最後素材可以是 Google Docs、Notion、內部 wiki、GitHub issue、Jira、email、LINE/Slack 短訊息或 Highlight Reel 分享頁。

格式不是重點,資訊架構才是重點。讀者要能快速找到:

- 問題。

- 答案。

- 來源。

- 假設。

- 決策。

- 下一步。

如果有人需要檢查 AI 對話本身,請給他一份乾淨頁面,而不是一整段原始 chat 牆。

研究分享時該保留什麼?

| 要保留 | 為什麼重要 | 常見失敗 |

|---|---|---|

| 研究問題 | 定義答案要解的問題。 | 只剩摘要,不知道原本在問什麼。 |

| 來源連結 | 讓團隊可以驗證 claim。 | 連結在截圖或轉貼中消失。 |

| 來源品質說明 | 區分官方、第一手、第二手、弱來源。 | 所有來源看起來一樣可靠。 |

| 假設 | 讓不確定性可見。 | 把模型自信誤認為證據。 |

| 衝突資訊 | 避免只留下最順的結論。 | 反方 evidence 被摘要時省略。 |

| 決策 | 連接研究和行動。 | 研究變成「有趣但沒用」。 |

| 下一步 | 讓 owner 和責任清楚。 | 大家都讀了,沒有人動。 |

可直接複製的 AI 研究分享模板

# [研究標題]

## 短答案

[用一段話回答研究問題。]

## 研究問題

[這份研究原本要回答的問題。]

## 主要 findings

1. [Finding] - Source: [連結或文件名稱]

2. [Finding] - Source: [連結或文件名稱]

3. [Finding] - Source: [連結或文件名稱]

## 來源清單

| Source | 類型 | 支持什麼 claim | 信心 |

| --- | --- | --- | --- |

| [標題 + 連結] | [官方 / 第一手 / 第二手 / 內部] | [claim 或段落] | [高 / 中 / 低] |

## 假設與不確定性

- 假設:[研究目前假設了什麼]

- 未驗證:[還要確認什麼]

- 衝突:[來源在哪裡不一致]

## 決策或建議

[團隊應該做、決定、測試或暫緩什麼。]

## 下一步

1. [動作] - [負責人] - [時間或觸發條件]

2. [動作] - [負責人] - [時間或觸發條件]

## 支持用 AI 對話

[乾淨 Highlight Reel 分享頁或 Markdown 逐字稿]這份模板刻意很樸素。好研究交接不是版面多華麗,而是團隊不用重新追一次來源。

AI 研究應該分享到哪裡?

| 目的地 | 適合情境 | 放什麼 |

|---|---|---|

| LINE、Slack、Teams | 快速通知、輕量審查。 | 短答案、2-3 個來源、下一步、乾淨研究連結。 |

| Google Docs、Notion、內部 wiki | 共編、留言、長期保存。 | 完整模板、來源表、審查註記、決策。 |

| GitHub issue、Jira | 研究已經變成要執行的工作。 | 建議、驗收標準、風險、支持連結。 |

| 外部或正式交接。 | 經整理的摘要、必要背景、來源連結、明確 ask。 | |

| Highlight Reel 分享頁 | 要保留 AI 研究對話裡真正有用的片段。 | 選過的 prompt、回答、來源連結和 Markdown export。 |

Google Drive 檔案分享可以設定 viewer、commenter 或 editor 權限。NotebookLM 也有 notebook 分享與來源存取的概念,但 Google 文件提醒,匯出到 Docs 或 Sheets 後,匯出檔案的變更不會自動同步回原 notebook,分享權限也不會自動跟著搬過去。

所以不要只想「我要貼哪個連結」。你要確認的是:對方打開後,能不能看到他有權看、也真的需要看的來源。

來源品質怎麼判斷?

不是所有來源都有一樣重量。可以用這個簡單順序:

- 官方文件或第一手來源。

- 原始研究、標準組織、監管單位或 vendor 文件。

- 有引用第一手材料的可信分析。

- 新聞或評論。

- 匿名貼文、無來源摘要、純模型推論。

NIST AI Risk Management Framework 的精神是把 AI 風險管理變成可操作的流程。放到日常研究裡,就是不要把 AI output 當 evidence。你要同時分享 evidence、AI 對 evidence 的綜合,以及人的決策。

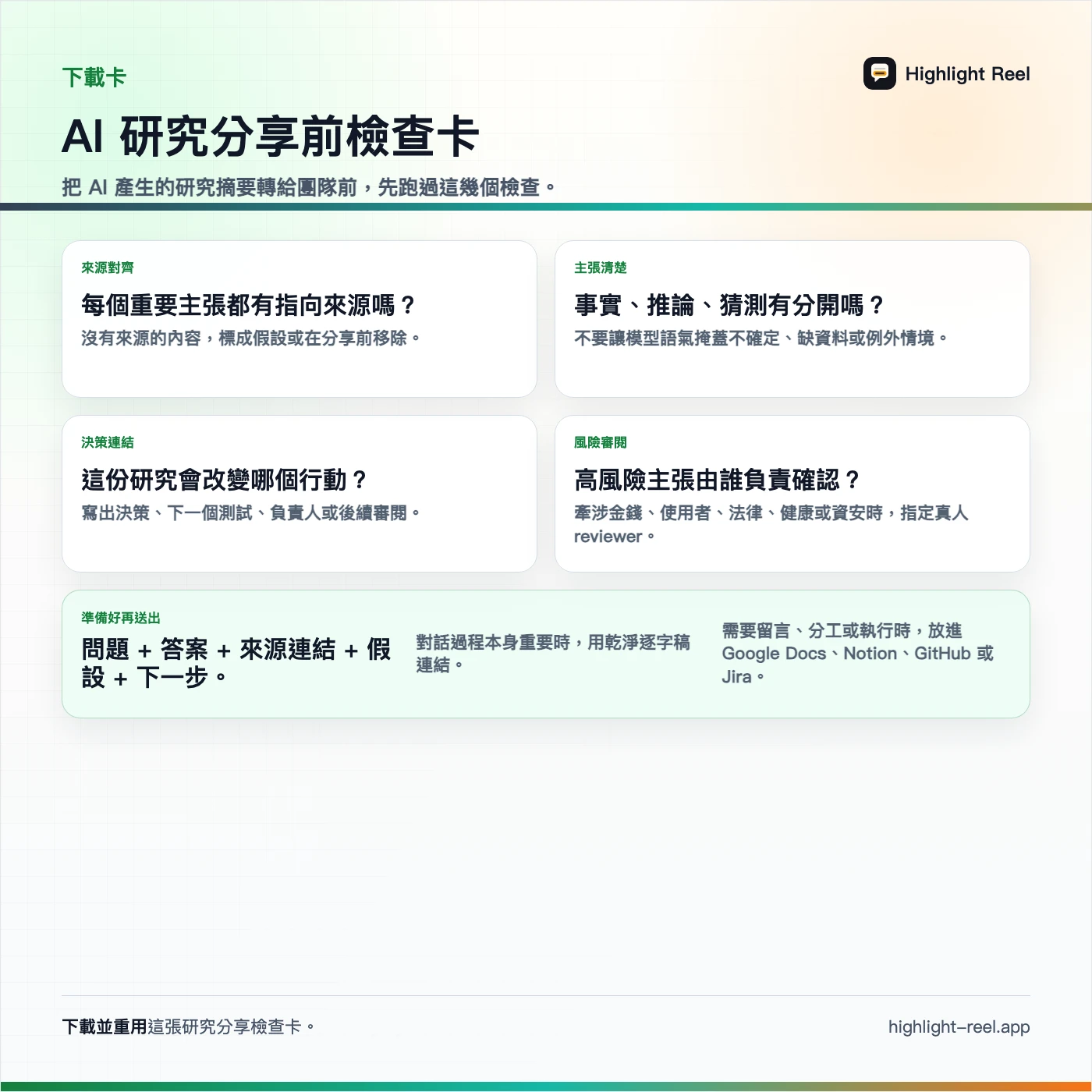

分享前檢查

在你把 AI 研究送給團隊前,確認:

- 研究問題在最上方看得到。

- 短答案沒有被來源表淹沒。

- 重要 claim 有來源,或被標成假設。

- 來源連結可以點。

- 內部來源名稱足夠清楚,授權同事找得到。

- 衝突資訊沒有被藏起來。

- 建議和 evidence 分開。

- 下一步有 owner。

- 敏感或私有內容已移除。

如果過不了這份 checklist,這份研究還不適合拿去決策。

用 Highlight Reel 保存 AI 研究片段

Highlight Reel 適合用在研究本身發生在 AI 對話裡的情境。

你可以用它:

- 保存有用的研究片段。

- 讓來源連結、表格和決策維持可複製文字。

- 分享乾淨頁面,而不是原始聊天對話。

- 匯出 Markdown,放進文件、issue、repo 或 wiki。

目的不是把 AI 研究包裝得比較漂亮。目的是讓 evidence 和 decision path 在對話結束後還能被團隊檢查和重用。

常見問題

AI 研究有 citations 就可靠嗎?

不一定。Citations 讓研究比較容易驗證,但不代表摘要一定正確。你仍然要檢查每個來源是否真的支持它旁邊的 claim。

要分享完整 AI 研究對話嗎?

通常不用。分享有用片段、來源連結、假設、衝突資訊和決策就好。只有當研究過程本身需要被審查時,才保留完整原始對話。

如果研究用了上傳檔案怎麼辦?

清楚寫出檔案名稱和它支持什麼。若檔案是內部資料,只能透過團隊原本的權限系統分享,不要把私有內容直接貼到公開或半公開素材。

來源互相衝突怎麼辦?

把衝突留下來。簡短說明目前比較相信哪個來源、原因是什麼,或指定 someone 去解決衝突後再讓團隊行動。

最後研究應該放哪?

需要共編就放 Google Docs、Notion 或 wiki;需要執行就放 GitHub issue 或 Jira;只是提醒可以貼 LINE、Slack 或 Teams;需要正式轉交就用 email;需要保存 AI 對話片段就用 Highlight Reel。